Rashmika Deepfake Video: ಏನಿದು ಅಪಾಯಕಾರಿ ‘ಡೀಪ್ಫೇಕ್ ವಿಡಿಯೋ’ ತಂತ್ರಜ್ಞಾನ?

ನಟಿ ರಶ್ಮಿಕಾ ಮಂದಣ್ಣ ಇವತ್ತು ಜಾಗತಿಕ ಮಟ್ಟದಲ್ಲಿ ಸುದ್ದಿಯಲ್ಲಿದ್ದಾರೆ. ಆದರೆ ರಶ್ಮಿಕಾ ಮಂದಣ್ಣ ಹೀಗೆ ಸುದ್ದಿಯಲ್ಲಿ ಇರುವುದು ಅವರ ಸಿನಿಮಾ ಕಾರಣಕ್ಕೆ ಅಲ್ಲ, ಈಗ ವೈರಲ್ ಆಗುತ್ತಿರುವ ರಶ್ಮಿಕಾ ಮಂದಣ್ಣ ಅವರ ಫೇಕ್ ವಿಡಿಯೋ ಕಾರಣಕ್ಕೆ. ಹಾಗಾದರೆ, ಏನಿದು 'ಡೀಪ್ಫೇಕ್ ವಿಡಿಯೋ' ತಂತ್ರಜ್ಞಾನ? ಮನುಷ್ಯರ ಭವಿಷ್ಯಕ್ಕೆ ಇದರಿಂದಾಗಿ ಏನೇನೆಲ್ಲಾ ಸಮಸ್ಯೆ ಎದುರಾಬಹುದು?

ಮನುಷ್ಯ ಹೀಗೆ ಒಂದು ಕೆಲಸ ಮಾಡು ಅಂದ್ರೆ ಅದರ ಜೊತೆಯಲ್ಲಿ ಇನ್ನೂ ಏನೇನೋ ಸಮಸ್ಯೆ ಹೊತ್ತು ತರುತ್ತಾನೆ. ಅದ್ರಲ್ಲೂ ತಂತ್ರಜ್ಞಾನದ ವಿಚಾರದಲ್ಲಿ ಮನುಷ್ಯರು ಮಾಡಿದ ತಪ್ಪುಗಳು ಒಂದಲ್ಲ, ಎರಡಲ್ಲ. ಹೀಗಿದ್ದರೂ ದಿನದಿಂದ ದಿನಕ್ಕೆ, ಕ್ಷಣಕ್ಷಣಕ್ಕೂ ತಂತ್ರಜ್ಞಾನ ಅಭಿವೃದ್ಧಿ ಮಾಡಲು ಮನುಷ್ಯ ಮುಂದಾಗುತ್ತಿದ್ದಾನೆ. ಈ ಪೈಕಿ 'ಕೃತಕ ಬುದ್ಧಿಮತ್ತೆ' ಅಂದ್ರೆ ಇಂಗ್ಲಿಷ್ ಭಾಷೆಯಲ್ಲಿ 'ಆರ್ಟಿಫಿಷಿಯಲ್ ಇಂಟಲಿಜೆನ್ಸ್' ಎನ್ನಲಾಗುವ ಮನುಷ್ಯರ ಭವಿಷ್ಯವನ್ನ ಈಗ ಕಸಿಯುತ್ತಿರುವ ತಂತ್ರಜ್ಞಾನ ನಟಿ ರಶ್ಮಿಕಾ ಅವರಿಗೂ ದೊಡ್ಡ ಆಘಾತ ನೀಡಿದೆ.

ಭಯಾನಕ 'ಡೀಪ್ಫೇಕ್ ವಿಡಿಯೋ' ತಂತ್ರಜ್ಞಾನ!

ಎಐ (AI) ಅಥವಾ 'ಆರ್ಟಿಫಿಷಿಯಲ್ ಇಂಟಲಿಜೆನ್ಸ್' ಅಂತ ಕರೆಯುವ ಕೃತಕ ಬುದ್ಧಿಮತ್ತೆ ತಂತ್ರಜ್ಞಾನ ಮನುಷ್ಯನಿಗೆ ಭವಿಷ್ಯದಲ್ಲಿ ದೊಡ್ಡ ಅಪಾಯ ತಂದೊಡ್ಡುತ್ತದೆ. ಈ ವಿಚಾರ ತಿಳಿದ ಕಾರಣಕ್ಕೆ ಹಲವು ದೇಶಗಳು ಆರ್ಟಿಫಿಷಿಯಲ್ ಇಂಟಲಿಜೆನ್ಸ್ ತಂತ್ರಜ್ಞಾನಕ್ಕೆ ಬ್ರೇಕ್ ಹಾಕಿದ್ದವು. ಇಷ್ಟಾದರೂ ಈಗ ಆಧುನಿಕ ಕಾಲಘಟ್ಟದಲ್ಲಿ ನಿಧಾನವಾಗಿ ಆರ್ಟಿಫಿಷಿಯಲ್ ಇಂಟಲಿಜೆನ್ಸ್ ತಂತ್ರಜ್ಞಾನ ಮನುಷ್ಯರನ್ನ ಆವರಿಸುತ್ತಿದೆ. ಇದೀಗ, ನಟಿ ರಶ್ಮಿಕಾ ಕೂಡ ಈ ಆರ್ಟಿಫಿಷಿಯಲ್ ಇಂಟಲಿಜೆನ್ಸ್ ತಂತ್ರಜ್ಞಾನದಿಂದ ಸಮಸ್ಯೆಗೆ ಒಳಗಾಗಿದ್ದಾರೆ. ಅಷ್ಟಕ್ಕೂ ಈ ತಂತ್ರಜ್ಞಾನ ಬಳಸಿ, 'ಡೀಪ್ಫೇಕ್ ವಿಡಿಯೋ' ತಯಾರಿಸುವುದು ಎಷ್ಟು ಸುಲಭ ಗೊತ್ತಾ.

ನಕಲಿ ವಿಡಿಯೋ ಗೊತ್ತೇ ಆಗಲ್ಲ!

ಹೇಗೆ ಅಂದರೆ ಯಾರದ್ದೋ ಮುಖಕ್ಕೆ, ಮತ್ತೊಬ್ಬರ ಮುಖವನ್ನು ಸೇರಿಸಿ ಗೊತ್ತಾಗದ ರೀತಿ ವಿಡಿಯೋ ಮಾಡುವುದು ಸುಲಭದ ಕೆಲಸವಾಗಿದೆ. ವೈಜ್ಞಾನಿಕ ಭಾಷೆಯಲ್ಲಿ 'ಡೀಪ್ಫೇಕ್ ವಿಡಿಯೋ' ಎಂಬುದು ಸಂಶ್ಲೇಷಿತ ಮಾಧ್ಯಮ. ಈ ತಂತ್ರಜ್ಞಾನ ಬಳಸಿ ಫೋಟೋ ಅಥವಾ ವಿಡಿಯೋದಲ್ಲಿ ಇರುವ ಯಾವುದೇ ವ್ಯಕ್ತಿಯನ್ನ ಬೇರೆಯವರ ಮುಖಕ್ಕೆ ವರ್ಗಾವಣೆ ಮಾಡಿ ನಕಲಿ ವಿಡಿಯೋ ಸೃಷ್ಟಿ ಮಾಡಬಹುದು. ಈ ರೀತಿಯ ವಿಡಿಯೋ ನೋಡುವ ಸಾಮಾನ್ಯ ಜನರಿಗೆ, ಅದು ನಕಲಿ ವಿಡಿಯೋನಾ? ಅಥವಾ ಅಸಲಿ ವಿಡಿಯೋನಾ? ಅನ್ನೋ ಸತ್ಯವೂ ಗೊತ್ತಾಗೋದಿಲ್ಲ.

PM @narendramodi ji's Govt is committed to ensuring Safety and Trust of all DigitalNagriks using Internet

— Rajeev Chandrasekhar 🇮🇳 (@Rajeev_GoI) November 6, 2023

Under the IT rules notified in April, 2023 - it is a legal obligation for platforms to

➡️ensure no misinformation is posted by any user AND

➡️ensure that when reported by… https://t.co/IlLlKEOjtd

ಜಗತ್ತಿನಾದ್ಯಂತ 'ಎಐ' ವಿಡಿಯೋ ಸಂಚಲನ!

ಅಷ್ಟಕ್ಕೂ ವಿಡಿಯೋಗಳನ್ನು ನಕಲಿ ಮಾಡಿ, ಪ್ರಸಿದ್ಧ ವ್ಯಕ್ತಿಗಳ ಜೀವನ ಹಾಳು ಮಾಡುವ ಕುತಂತ್ರ ಈ ಮೊದಲಿನಿಂದ ಕೂಡ ನಡೆಯುತ್ತಿದೆ. ಆದರೆ ಈ ರೀತಿಯ ದುಷ್ಕೃತ್ಯ ಎಸಗಿ, ಬೇರೊಬ್ಬರ ಜೀವನದ ಜೊತೆಯಲ್ಲಿ ಆಟವಾಡುವ ಕಿಡಿಗೇಡಿಗಳು ಈಗ 'ಆರ್ಟಿಫಿಷಿಯಲ್ ಇಂಟಲಿಜೆನ್ಸ್' ಮೊರೆ ಹೋಗಿದ್ದಾರೆ. 'ಎಐ' ತಂತ್ರಜ್ಞಾನ ಬಳಸಿ ಯಾವುದೋ ವ್ಯಕ್ತಿಯ ಅಶ್ಲೀಲ ವಿಡಿಯೋ ಅಥವಾ ನಕಲಿ ವಿಡಿಯೋ ರಚನೆ ಮಾಡುತ್ತಿದ್ದಾರೆ ಕಿಡಿಗೇಡಿಗಳು. ಈ ವಿಡಿಯೋದಲ್ಲಿ ಸ್ಪಷ್ಟವಾದ ಆಡಿಯೋ ಮತ್ತು ಚಿತ್ರ ಬಳಸುವಷ್ಟು 'ಎಐ' ತಂತ್ರಜ್ಞಾನವು ಕೂಡ ದುಷ್ಕರ್ಮಿಗಳಿಗೆ ಸಹಾಯ ಮಾಡುತ್ತದೆ. ಇದೇ ಕಾರಣಕ್ಕೆ ಇದೀಗ ಜಗತ್ತಿನಾದ್ಯಂತ ಎಐ ತಂತ್ರಜ್ಞಾನದ ಈ 'ಡೀಪ್ಫೇಕ್ ವಿಡಿಯೋ' ಬಗ್ಗೆ ಕಿಚ್ಚು ಹೊತ್ತಿಕೊಂಡಿದೆ.

yes this is a strong case for legal https://t.co/wHJl7PSYPN

— Amitabh Bachchan (@SrBachchan) November 5, 2023

ಒಟ್ನಲ್ಲಿ ನಟಿ ರಶ್ಮಿಕಾ ಮಂದಣ್ಣ ಅವರ ನಕಲಿ ವಿಡಿಯೋ ಈಗ ಇಡಿ ಜಗತ್ತಿಗೆ ಪಾಠವಾಗಿ ಮನುಷ್ಯರು ಎಚ್ಚೆತ್ತುಕೊಳ್ಳಬೇಕು. ಇಲ್ಲವಾದರೆ ಪರಿಸ್ಥಿತಿ ಕೈಮೀರಿ ಹೋಗುತ್ತದೆ. ಯಾರು, ಯಾರ ವಿಡಿಯೋ ಅಥವಾ ಫೋಟೋ ಬೇಕಾದರೂ ನಕಲಿ ಮಾಡಿ ಆಟ ಆಡುತ್ತಾರೆ. ಈ ಪರಿಸ್ಥಿತಿ ಸೃಷ್ಟಿಯಾದರೆ ಸಮಾಜದಲ್ಲಿ ಘೋರ ಪರಿಸ್ಥಿತಿ ನಿರ್ಮಾಣವಾಗುತ್ತದೆ. ಇಷ್ಟಲ್ಲದೆ, ತಪ್ಪು ಮಾಡಿದವರು ಬಚಾವ್ ಆಗಿ ತಪ್ಪನ್ನ ಮಾಡದ ವ್ಯಕ್ತಿ ಸಮಸ್ಯೆಗೆ ಸಿಲುಕುವ ಸಂಭವ ಹೆಚ್ಚು. ಹೀಗಾಗಿ ಕೇಂದ್ರ ಸರ್ಕಾರ ಕೂಡ, ನಕಲಿ ವಿಡಿಯೋ ವಿಚಾರವನ್ನು ಗಂಭೀರವಾಗಿ ಪರಿಗಣಿಸಿದೆ. ಅಲ್ಲದೆ ಈ ಬಗ್ಗೆ ಕಠಿಣ ಕ್ರಮ ಕೈಗೊಳ್ಳುವ ಬಗ್ಗೆ ಎಚ್ಚರಿಕೆ ಸಂದೇಶವನ್ನೂ ಕೊಡಲಾಗಿದೆ.

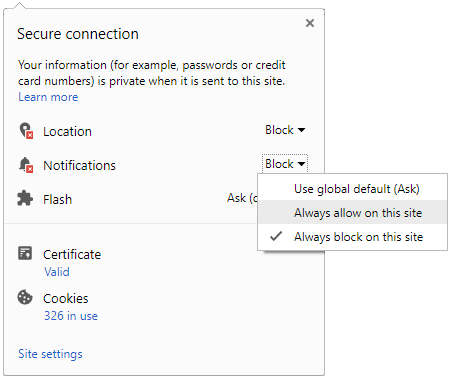

Click it and Unblock the Notifications

Click it and Unblock the Notifications