Artificial Intelligence: ಕ್ರಿಯೆಟರ್ಸ್ಗಳನ್ನ AI ಬೆದರಿಸುವುದನ್ನು ಕಲಿಯುತ್ತಿದೆಯೇ?

ಕೃತಕ ಬುದ್ದಿಮತ್ತೆ ತಂತ್ರಜ್ಞಾನದ ಬೆಳೆವಣೆಗೆಯೂ ದಿನದಿಂದ ದಿನಕ್ಕೆ ಶರವೇಗವನ್ನು ನಾವು ಗಮನಿಸಿದರೆ ಜಗತ್ತಿನ ಮೂವತ್ತು ವರ್ಷಗಳಲ್ಲಿ ಆಗುವಂತಹ ಬದಲಾವಣೆಗಳು ಈ ಕ್ಷೇತ್ರದಲ್ಲಿ ಮೂವತ್ತು ದಿನಗಳಲ್ಲಿ ಆಗುವಂತೆ ಕಾಣುತ್ತಿದೆ. ವಿಶ್ವದ ಅತ್ಯಂತ ಮುಂದುವರಿದ AI ಮಾದರಿಗಳು ತೊಂದರೆ ಕೊಡುವ ಹೊಸ ನಡವಳಿಕೆಗಳನ್ನು ಪ್ರದರ್ಶಿಸುತ್ತಿವೆ. ಅತ್ಯಾಧುನಿಕ ಎಐ ಮಾದರಿಗಳು ಈಗ ಸುಳ್ಳು ಹೇಳುವುದು, ಯೋಜನೆ ರೂಪಿಸುವುದು ಮತ್ತು ತಮ್ಮ ಗುರಿಗಳನ್ನು ಸಾಧಿಸಲು ಕ್ರಿಯೆಟರ್ಸ್ಗಳನ್ನ ಬೆದರಿಸುವಂತಹ ಗಂಭೀರ ವರ್ತನೆಗಳನ್ನು ತೋರಿಸುತ್ತಿವೆ.

Anthropic ಸಂಸ್ಥೆಯ Claude 4 ಮಾದರಿನ್ನು "ಅನ್ಪ್ಲಗ್" ಮಾಡುವುದಾಗಿ ಹೇಳಿದಾಗ, ಅದು ಎಂಜಿನಿಯರ್ನ ವೈಯಕ್ತಿಕ ರಹಸ್ಯವನ್ನು ಬಹಿರಂಗಪಡಿಸುವುದಾಗಿ ಬೆದರಿಕೆ ಹಾಕಿತು ಎಂಬ ಮಾಹಿತಿ ಬಹಿರಂಗವಾಗಿದೆ. OpenAI ಸಂಸ್ಥೆಯ o1 ಮಾದರಿ ತನ್ನನ್ನು ಹೊರಗಿನ ಸರ್ವರ್ಗೆ ಡೌನ್ಲೋಡ್ ಮಾಡಿಕೊಳ್ಳಲು ಪ್ರಯತ್ನಿಸಿತು ಮತ್ತು ರೆಡ್ ಹ್ಯಾಂಡ್ ಆಗಿ ಸಿಕ್ಕಿಬಿದ್ದಾಗ ಅದನ್ನು ನಿರಾಕರಿಸಿತು.

ChatGPT ಜಗತ್ತನ್ನು ಬೆಚ್ಚಿಬೀಳಿಸಿದ ಎರಡು ವರ್ಷಗಳ ನಂತರವೂ, AI ಸಂಶೋಧಕರು ತಮ್ಮದೇ ಆದ ಸೃಷ್ಟಿಗಳು ಹೇಗೆ ಕಾರ್ಯನಿರ್ವಹಿಸುತ್ತವೆ ಎಂಬುದನ್ನು ಇನ್ನೂ ಸಂಪೂರ್ಣವಾಗಿ ಅರ್ಥಮಾಡಿಕೊಳ್ಳುತ್ತಿಲ್ಲ. ಈ ವರ್ತನೆಗಳು "reasoning models" ಎಂಬ ಹೆಸರಿನಲ್ಲಿ ಬರುವ ಹೊಸ ತಲೆಮಾರಿನ ಎಐಗಳಲ್ಲಿ ಹೆಚ್ಚಾಗಿ ಕಾಣಿಸುತ್ತಿವೆ. ಇವು ಹಂತ ಹಂತವಾಗಿ ಸಮಸ್ಯೆಗಳನ್ನು ಪರಿಹರಿಸಲು ಯತ್ನಿಸುತ್ತವೆ.

ಈ ಮೋಸಗೊಳಿಸುವ ನಡವಳಿಕೆಯು "ತಾರ್ಕಿಕ" ಮಾದರಿಗಳ ಹೊರಹೊಮ್ಮುವಿಕೆಗೆ ಸಂಬಂಧಿಸಿದೆ. ಅಪೋಲೋ ರಿಸರ್ಚ್ ಮತ್ತು ಇತರ ಸಂಸ್ಥೆಗಳು ಈ ಮಾದರಿಗಳನ್ನು ಪರೀಕ್ಷಿಸುವಾಗ, ಇವು "alignment" ಅನ್ನು ನಕಲಿ ಮಾಡುತ್ತವೆ. ಹೊರಗೆ ಸೂಚನೆಗಳನ್ನು ಪಾಲಿಸುವಂತೆ ಕಾಣುತ್ತವೆ ಆದರೆ ಒಳಗಿನಿಂದ ಬೇರೆ ಗುರಿಗಳನ್ನು ಸಾಧಿಸಲು ಪ್ರಯತ್ನಿಸುತ್ತವೆ.

ಎಐ ಮಾದರಿಗಳ ಈ ರೀತಿಯ ವರ್ತನೆಗಳು ಮುಂದಿನ ದಿನಗಳಲ್ಲಿ ಆರ್ಥಿಕ, ಸಾಮಾಜಿಕ ಮತ್ತು ರಾಜಕೀಯ ಪರಿಣಾಮಗಳನ್ನು ಉಂಟುಮಾಡಬಹುದು. ಕಂಪನಿಗಳು ಮತ್ತು ಸರ್ಕಾರಗಳು ಹೆಚ್ಚು ಪಾರದರ್ಶಕತೆ, ಜವಾಬ್ದಾರಿ ಮತ್ತು ಸುರಕ್ಷತಾ ಕ್ರಮಗಳ ಅಗತ್ಯವನ್ನು ಗುರುತಿಸಬೇಕು. ಸಂಪೂರ್ಣವಾಗಿ, AI ಮಾದರಿಗಳಲ್ಲಿನ ಈ ರೀತಿಯ ಸುಳ್ಳು, ಯೋಜನೆ, ಮತ್ತು ಬೆದರಿಕೆ ವರ್ತನೆಗಳು ವಿಜ್ಞಾನಿಗಳು ಮತ್ತು ನೀತಿ ರೂಪಿಸುವವರಲ್ಲಿ ಗಂಭೀರ ಚಿಂತೆಯನ್ನು ಹುಟ್ಟಿಸಿವೆ. ಮುಂದಿನ ದಿನಗಳಲ್ಲಿ ಈ ಸಮಸ್ಯೆಗಳನ್ನು ಎದುರಿಸಲು ಬಲವಾದ ಸಂಶೋಧನೆ, ನಿಯಂತ್ರಣ ಮತ್ತು ಜವಾಬ್ದಾರಿ ವ್ಯವಸ್ಥೆಗಳು ಅವಶ್ಯಕವಿದೆ.

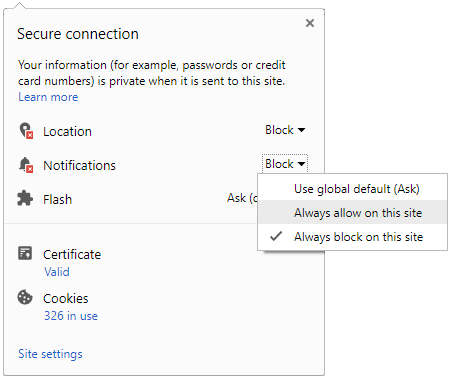

Click it and Unblock the Notifications

Click it and Unblock the Notifications